OpenAI는 어디로 가는가

지지난주 OpenAI 창업자이자 CEO인 샘 알트먼이 전격 해임되었다.

- 이사화와의 의사소통이 일관되지 않았다.

- 이사회는 그가 OpenAI를 잘 이끌 수 있을지 확신이 없다.

샘 알트먼은 해고를 전혀 몰랐다.

- 최대 주주 마이크로소프트도 몰랐다.

갑자기 왜?

- 샘 알트먼의 해고는 불법행위나 재무, 비즈니스, 안전, 보안/개인정보 등과 관련된 결과가 아니다

- 단지 이사회와의 커뮤니케이션 중단의 결과다.

최대 주주도, CEO도 모르게 이사회에서 해고를 어떻게 결정할 수 있었을까

- OpenAI는 인류에게 혜택을 줄 수 있는 일반 인공지능을 위해 설립된 비영리기관

- 오픈AI 설립목적

다만 비영리기관은 최고의 인재들을 데려오는데 한계가 있다.

- OpenAI Global이라는 영리 회사를 자회사로 설립

- 이 곳의 투자자는 이익 상한 100배를 기준으로 영리 가능

- 수익제한 투자자

오픈AI의 특이한 구조

Open AI 이사회의 의무

- Open AI 이사들은 주주의 이익을 극대화할 의무가 없다.

- 비영리법인, 자선단체이기 때문에.

- 대신 인류에게 안전한 AI를 창출해야 하는 의무가 있다.

그런데 엄청난 경제적 성공을 거둔 샘 알트먼과 ChatGPT

- 오픈AI의 가치는 800억 달러로 추산된다 (약 100조 원)

마이크로소프트 오픈AI에 총 130억 달러 투자

- 투자금을 회수할 때까지 오픈AI 수익의 75%를 가져가는 조건

- 영리법인의 지분 49% 획득

마이크로소프트를 중심으로 한 투자자들은 당연히 오픈AI의 빠른 성장과 경제적 성공을 바란다.

- 비영리법인 오픈AI와 영리법인 오픈AI Global간의 이해상충 문제 발생

안전하고 천천히 AI 개발 vs 빠르고 상업적 성공인 AI개발

샘 알트먼이 오픈AI CEO임에도 AI의 위험성을 설파하고 다닌 것은 이유가 있다.

- 인류를 위해 안전한 AI개발이 오픈AI 설립 목적

- 자신의 운명을 결정할 수 있는 이사회는 돈을 원하는 집단이 아니다.

- 인류에게 안전한 AI의 임무

오픈AI 이사회 구조

- 4명의 합의면 곧 과반수이자 2/3

그런데 어느날 밤 이사회에서 전격적으로 샘 알트먼 해고 결정

- 공동 창립자 수츠케버와 사외이사 3인의 기습결정

- 6명 중 4명의 찬성으로 샘 알트먼 해고와 그렉 브록먼 이사회 의장직 해임

깜짝 놀란 오픈AI 투자자들

- 오픈AI의 투자자들이 샘 알트먼을 다시 데려오기 위해 노력하고 있다.

크게 화가 났다고 알려진 샘 알트먼

- 그의 친구들과 동료들은 금요일 밤의 쿠데타를 비난했다.

샘 알트먼 선

- 돌아갈 수는 있지만 새로운 이사회와 지배구조가 보장되어야 한다.

- 아니면 전 오픈AI 직원과 반발로 그만둔 몇몇 직원을 데리고 새로운 기업을 세울 것

새로운 기업을 세우게 둘 수는 없는 마이크로소프트

- 마이크로소픝 샘 알트먼과 그렉 브록먼 고용 발표

- 우리는 샘 알트먼과 그렉 브록먼이 마이크로소프트에 합류한 것을 전하게 되어 대단히 기쁘다.

분노가 차오르는 오픈AI직원들

- 우리사주 매각 기회가 날라갔다.

- 오픈AI의 기업가치를 860억 달러로 하는 주식 매각이 샘 알트먼 해고 이후 위기에 빠졌다.

- 직원들은 이 거래로 보유 주식들을 팔 수 있을 것으로 예상되고 있었다.

오픈AI 직원들 즉시 샘 알트먼 지지 선언

- 오픈AI 임직원 600명은 샘 알트먼 복귀란느 자신들의 요구를 들어 주지 않을 경우, 마이크로소프트로 이직할 것이라고

위협했다.

- 약 700명의 임직원 중 600명이 이직하면 오픈AI는 공중분해

샘 알트먼 오픈AI 방문

- 최초이자 마지막으로 오픈AI에 게스트 방문증 받고 들어간다.

- 이사진 만나러 옴

- 공중 분해냐 백기 투항이냐 선택하라

이 사태를 일으킨 장본인인 일리야 수츠케버도 직원들의 요구에 동참

- 나는 이사회에서 내가 했던 행동에 대해 깊이 후회핟나.

- 오픈AI를 해하려는 의도는 없었다.

- 우리가 만든 것들을 사랑하며 회사를 재통합하기 위해 노력하겠다.

결국 OpenAI 이사회 백기투항

- 우리는 샘 알트먼이 오픈AI의 CEO로 복귀하는 것에 최종 합의했다.

이사진은 사실상 전원 교체될 것으로 전망

- 나름 중도파로 알려진 디앤젤로만 남고 5명은 결과적으로 전부 교체

그런데 오픈AI이사회는 감당하지도 못할 일을 왜 저지른 것일까?

오픈AI 연구원들이 CEO 해고 직전에 강력한 AI혁신을 경고했다.

- 몇몇 연구원들이 이사회에 편지를 써서 인류를 위협할 수 있는

강력한 인공지능의 발견에 대해 경고했다.

오픈AI의 프로젝트 Q스타

- 이 AI알고리즘은 알트먼을 축출하기 이전의 핵심 개발이었다.

- 오픈AI도 인정한 이 프로젝트의 이름은 Q스타였다.

강인공지능의 돌파구로 여겨지는 Q스타 프로젝트

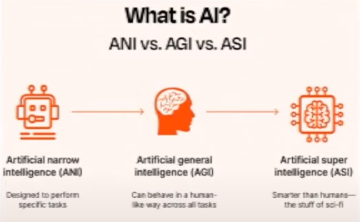

- 오픈AI의 일부 직원들은 Q스타가 일반 인공지능 (AGI, 소위 강인공지능)으로 갈 수 있는 돌파구가 될 수 있을 것으로

믿고 있다.

- 오픈AI는 일반인공지능을 가장 경제적으로 가치있는 직업에서 인간을 능가하는 자율 시스템으로 정의한다.

문제 해결능력을 지닌 것으로 알려진 프로젝트 Q스타

- 방대한 컴퓨팅 자원을 바탕으로, 수학적 문제를 해결할 수 있었다.

- AI가 수학을 정복한다는 것은 인간 지능과 유사한 더 큰 추론 능력을 가지게 된다는 것을 의미한다.

고도로 지능화된 AI의 등장 가능성

- 제한된 연산을 풀 수 있는 계산기와는 달리 강인공지능은 일반화하고 (스스로) 학습하과 이해할 수 있다.

- 이것은 새로운 과학연구에 사용될 수 있을 것이다.

- 연구원들은 Q스타의 성공에 대단히 낙관적이었다.

일반 인공지능(AGI)의 정의

- 대부분의 작업에서 인간을 능가 할 수 있는 고도의 자율화된 시스템

- 거의 모든 일을 할 수 있고 사람처럼 스스로 학습한다.

해고 직전 의미심장했던 샘 알트먼의 발표

- 오픈 AI의 역사상 네 번이나 우리는 무지의 베일을 뒤로 밀고 발견의 최전선을 넓혀갈 수 있었다.

- 가장 최근의 경우는 지난 몇 주 동안 있었다.

이 발표 하루 뒤 이사회는 샘 알트먼을 해고 했다.

월스트릿저널

- 샘 알트먼의 해고는 AI 발전이 느려져야 한다는 견해를 보여주었다.

- 샘 알트먼의 해고는 '효과적인 이타주의'의 영향과 'AI발전이 느려져야 한다'는 견해를 보여주었다.

효과적 이타주의 (effective altruism)?

최대 다수의 혜택이 되도록 가장 긴급한 전 세계적 문제를 해결하기 위해 연구를 사용해야 한다는 운동

- 최대 다수의 행복이라는 공리주의와 연관이 있는 개념

- 비영리 단체를 촉발시켰다.

- 인류 멸종 시나리오를 막아야 한다는 임무로 확대

실리콘밸리 전반에 퍼진 하나의 믿음

- AI의 팽창을 우려하는 목소리는 효과적 이타주의 운동의 주요 동력 중 하나였다.

- 이를 통해 효과적 이타주의는 실리콘밸리와 AI산업에서 매우 영향력 있는 철학이 되었다.

한편 이번 사태에 동참한 오픈AI의 이사진은 어땠을까?

1. 수츠캐버는 AI의 안전성 문제를 두고 알트먼과의 갈등 격화

(개발 속도를 늦추자는 입장)

2. 수츠캐버의 알트먼 해임안에 동조한 Tasha McCauley는 효과적 이타주의의 주요 멤버

샘 알트먼이 솔직하지 않게 빠르게 상업적인 발전을 꿈꾼다.

- 이사회 멤버들은 샘 알트먼이 일관되게 솔직하지 못했다고 말했다.

그 결과

이사회 멤버들은 인류를 구원할 수 있는 유일한 존재라고 너무 깊게 믿는 사람들은 결국

극단적인 행동을 하게 되는 경향이 있다.

Bloomberg 기사

샘 알트먼 사태는 '세계관 충돌의 정점'이었다.

- 샘 알트먼의 신속한 해고와 빠른 복직은 오랫동안 지속된 세계관 충돌의 정점을 보여준다.

- 상업적 야망 vs AI가 인류를 멸망시킬 수도 있다는 우

어느 날 오픈AI로 배달된 클립으로 만든 오픈AI 로고

- AI 커뮤니에서 오픈AI의 로고는 파멸의 상징이 되었다.

사실은 그래서 오픈AI를 비영리재단으로 만들었다.

- 그러나 자본주의는 이 구조를 깨뜨렸다.

뉴욕타임즈 기사

오픈AI는 이제 유토피아를 위해 달릴 준비를 마쳤다.

- AI는 자본가들에게 넘어갔다. 오픈AI에 대한 갈등은 AI에 대한 서로 다른 2가지 전망에서 비롯되었고

한쪽이 완전히 승리했다. 이제 경영진들은 유토피아를 향해 전속력으로 달릴 예정이다.

AI 발전에 제동을 걸고 있는 각국 정부

- 2023년 6월 EU 의회는 일명 AI법을 통과시키며 AI 기업이 프로그램 개발 과정에서 사용된 데이터를 각국 정부에게

더 많이 공개하라고 요구했다.

10월 30일 바이든 역시 AI규제에 대한 행정명령 발표

- 행정명령은 AI개발자들이 안전 테스트 결과를 정부와 공유하고 국립 표준기술원이 AI툴의 대중 공개 이전 그것이 안전한지 확인할 수 있는 기준을 수립하도록 한다.

-> 즉 사전 예방 조치에 중점을 둔 행정명령

그러자 해당 조치가 AI 후발주자에 대한 진입장벽이라는 논란 발생

'재미있는 경제이야기' 카테고리의 다른 글

| 원수가 있다면 추천하라는 지역주택조합(지주택)사업 231129 (1) | 2023.11.29 |

|---|---|

| 생활형숙박시설 - 주거용이 아닙니다 231129 (1) | 2023.11.29 |

| 절반의 성공, 달로 가는 인류의 도전 231123 (0) | 2023.11.23 |

| 해운업 영업이익 쇼크, 반복되는 역사 231118 (1) | 2023.11.23 |

| 뻥튀기 가격 상장, 우리는 왜 분노하는가 231113 (0) | 2023.11.19 |